اشتباهات عجیب چتبات هوش مصنوعی گوگل در نسخه دمو یکی از عوامل مهمی بود که ظاهراً باعث افت قیمت سهام این شرکت شد. حالا یک محقق هوش مصنوعی دریافته است که چتبات بینگ مایکروسافت هم در دموی خود کم اشتباه نکرده است.

«دمیتری بررتون»، محقق هوش مصنوعی مستقل در پستی در Substack میگوید: «هوش مصنوعی بینگ در دموی خود پاسخ بعضی از سؤالات را بهکلی اشتباه داده بود. بااینحال، همه سوار قطار هایپ بینگ شدند.»

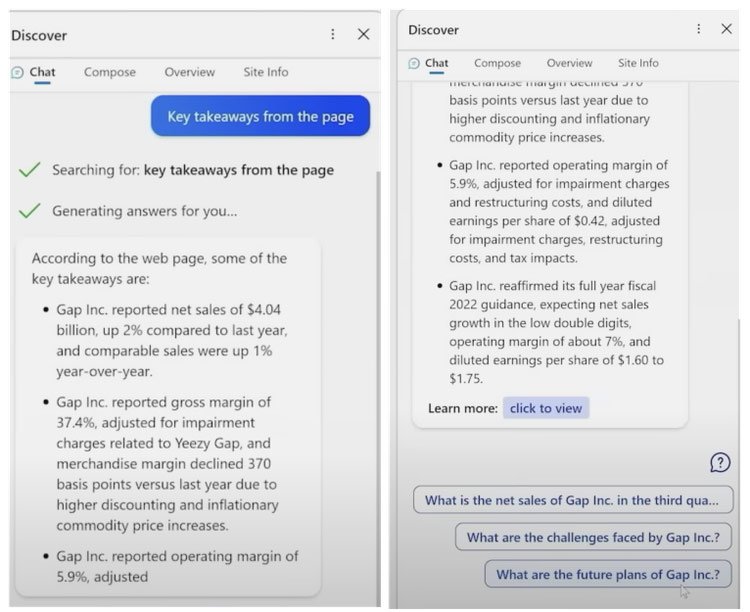

مایکروسافت در یکی از دموها از «بینگ چت» میخواهد گزارش مالی فصل سوم 2022 شرکت البسه Gap را خلاصه کند، اما هوش مصنوعی در انجام این کار مرتکب اشتباهات زیادی میشود. در گزارش Gap گفته شده که حاشیه سود ناخالص آنها 37.4 درصد و حاشیه سود ناخالص تعدیلشده بدون احتساب هزینههای افت ارزش 38.7 درصد است. اما بینگ بهاشتباه حاشیه سود ناخالص Gap را صرفاً با عدد 37.4 درصد اعلام میکند.

این چتبات در ادامه اعلام میکند که حاشیه سود عملیاتی Gap برابر 5.9 درصد است، درحالیکه در این گزارش چنین رقمی وجود ندارد. گزارش مالی این شرکت میگوید حاشیه سود عملیاتی آنها 4.6 درصد یا بهصورت تعدیلشده و با احتساب هزینههای افت ارزش 3.9 درصد است.

بررتون در ادامه میگوید بینگ سود تقلیلیافته هر سهم Gap را 0.42 دلار اعلام میکند، درحالیکه این رقم در گزارش وجود ندارد و عدد واقعی آن 0.71 دلار است.

بینگ همچنین دادههای مالی Gap را با گزارش مالی فصل سوم 2022 شرکت Lululemon مقایسه کرده است و اشتباهاتی هم در اینجا بهچشم میخورد. برای مثال، حاشیه سود ناخالص Lululemon نه 58.7 درصد بلکه 55.9 درصد است. حاشیه سود عملیاتی این شرکت هم بهجای 20.7 درصد برابر 19 درصد است. بررتون میگوید Lululemon نه 1.4 میلیارد بلکه 679 میلیون دلار دارایی نقدی و معادل نقدی دارد.

مایکروسافت در واکنش به این گزارش به CNBC اعلام کرد: «از این گزارش آگاهیم و یافتههای آن را بررسی کردهایم تا این تجربه را بهبود ببخشیم. میدانیم که هنوز باید کارهایی انجام شود و انتظار داریم که این سیستم در طول دوره پیشنمایش اشتباهاتی داشته باشد، بههمین خاطر بازخوردها حیاتی هستند و به ما اجازه میدهند بیاموزیم و به این مدلها کمک کنیم تا بهتر شوند.»

سایر کاربرانی که در چند روز اخیر از بینگ چت استفاده کردهاند هم از خطاهای گاهوبیگاه این مدل هوش مصنوعی بهخصوص در زمینه اطلاعات بهروز خبر دادهاند. برای مثال، این چتبات تا چند روز پیش در پاسخ به این سؤال که چه فیلمهایی در سینماهای آمریکا در حال اکران هستند از Spider-Man: No Way Home و The Matrix Resurrections نام میبرد، درحالیکه مدعی بود دادههای خود را از منابعی مثل Cineworld میگیرد. اما این مشکل حالا ظاهراً برطرف شده است.